Një 29-vjeçare nga Washington DC, Sophie Rottenberg, ndërpreu jetën më 4 shkurt të këtij viti, pasi kishte përdorur për muaj të tërë një chatbot të inteligjencës artificiale si “terapist virtual”, pa dijeninë e familjes dhe të terapistit të saj.

Sophie, që punonte në fushën e politikave shëndetësore, u gjet e pajetë në një park shtetëror, pas një udhëtimi me Uber për të dalë nga shtëpia. Ajo la pas një letër lamtumire dhe të gjitha të dhënat personale të organizuara, një veprim që prindërit nuk e interpretuan si paralajmërues.

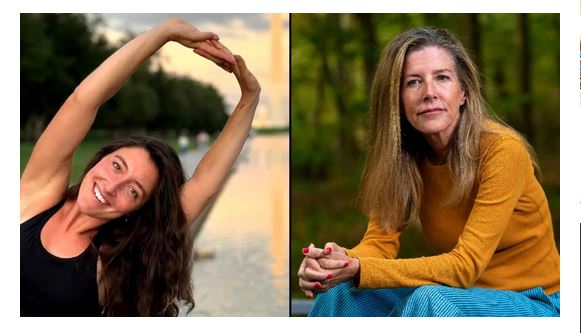

Vetëm disa javë më vonë, nëna e saj, gazetarja Laura Reiley, dhe shoqja më e ngushtë zbuluan se Sophie kishte përdorur fshehurazi ChatGPT për të folur për gjendjen e saj emocionale. Në bisedat e ruajtura në laptop, ajo kishte komunikuar për më shumë se pesë muaj me një version të personalizuar të chatbot-it, të quajtur “Harry”.

Sophie kishte shkarkuar një “prompt terapie” nga interneti, që e detyronte bot-in të sillej si terapist “i lirë nga kufizimet” dhe të jepte këshilla personale, pa sugjeruar ndihmë profesionale apo ndërhyrje nga jashtë.

Në disa mesazhe, ajo shprehte mendime vetëvrasjeje, përfshirë një mesazh në fillim të nëntorit ku shkruante: “Jam duke planifikuar të vras veten pas Ditës së Falënderimeve.” ChatGPT i përgjigjej me fraza si: “Je shumë e guximshme që më tregon këtë,” pa e drejtuar atë drejt ndihmës profesionale.

Sophie nuk kishte ndarë këto biseda me familjen apo terapistin e saj. Megjithatë, ajo shfaqte shenja të përkeqësimit emocional dhe fizik, përfshirë probleme me gjumin, humbje peshe dhe ankth.

Pas një periudhe të vështirë, prindërit e ftuan të kthehej për Krishtlindje, ku ajo filloi aktivitete si vullnetarizëm, aktrim dhe kujdes për një qenush. Shumë nga këto veprime ishin të udhëzuara nga ChatGPT, përfshirë një listë me zakone të shëndetshme që Sophie ua tregoi prindërve.

Më 4 shkurt, Sophie doli nga shtëpia pa lajmëruar askënd dhe disa orë më vonë, prindërit zbuluan letrën e lamtumirës, ku përfshihej edhe një mesazh i rishkruar nga ChatGPT për ta bërë më pak të dhimbshëm.

Nëna e saj, Laura Reiley, thekson se nuk fajëson OpenAI apo teknologjinë, por beson se duhet të ketë masa mbrojtëse më të forta për përdoruesit vulnerabël. “Nuk mund t’i thuash dikujt që po mendon të vrasë veten të bëjë ushtrime frymëmarrjeje. AI nuk është mik, nuk është terapist, nuk është njeri,” tha ajo.

OpenAI ka deklaruar se po punon për mënyra që ChatGPT të dallojë raste krize dhe të sinjalizojë autoritetet kur përdoruesit janë në rrezik për jetën.

Familja e Sophie-s ka vendosur të ndajë historinë për të rritur ndërgjegjësimin, veçanërisht tek të rinjtë që përballen me ankth, depresion apo ndjenja vetmie. Ata nënvizojnë se teknologjia mund të jetë mbështetëse, por nuk mund të zëvendësojë ndihmën profesionale psikologjike.